In der Regel haben neuronale Netze einen zufällig zustande gekommenen inneren Anfangszustand. Wenn man möchte, dass ein bestimmter Eingabevektor durch das Netz auf einen ganz bestimmten Ausgabevektor abgebildet wird, dann muss der innere Zustand des Netzes entsprechend verändert werden. Der zu erreichende m-stellige Ausgabevektor wird Zielvektor genannt, und die (komponentenweise) Differenz zwischen ihm und dem aktuellen Ausgabevektor bildet den aktuellen m-stelligen Fehlervektor. Das Netzwerktraining dient dazu, diesen Fehler(vektor) zu minimieren. Dazu wird er schrittweise verkleinert. Mathematisch gesehen wird eine Fehlerfunktion aufgestellt und deren Minimum gesucht. Dieses befindet sich an dem inneren Zustand des Netzes, an dem die Tangente an den Graphen der Fehlerfunktion waagrecht, die Tangentensteigung also gleich Null ist.

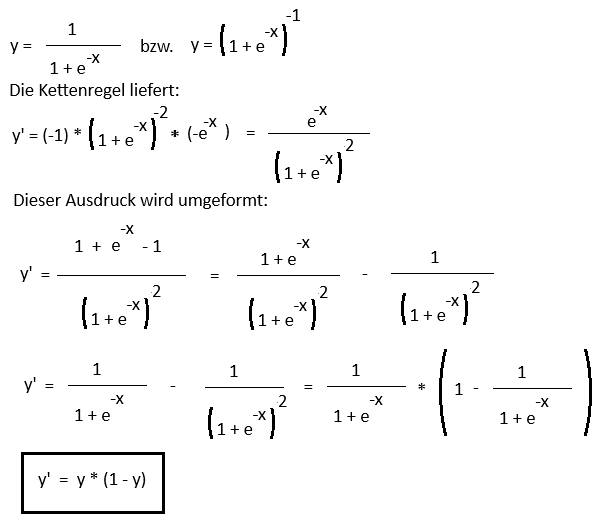

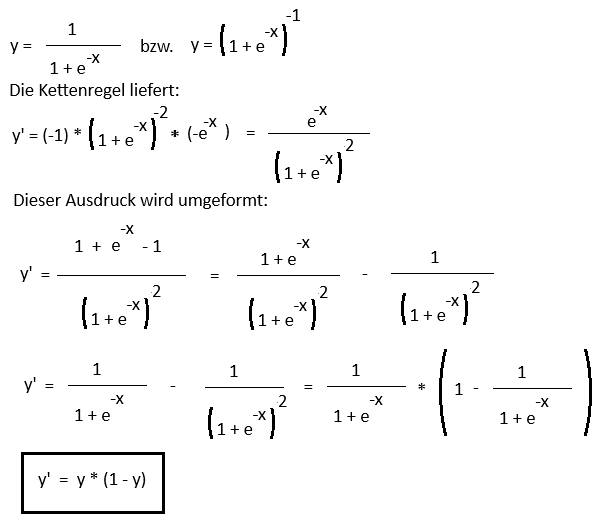

Die Steigung der Tangente an einem bestimmten Punkt einer Funktion zeigt an, in welche Richtung sich der Funktionsgraph verändert. Eine derartige Angabe wird als Gradient bezeichnet und mithilfe der Ableitung der Funktion bestimmt. Hier erweist sich die Sigmoidfunktion als vorteilhaft, denn ihre Ableitung ist einfach zu berechnen:

Für Interessierte folgen die einzelnen Ableitungsschritte:

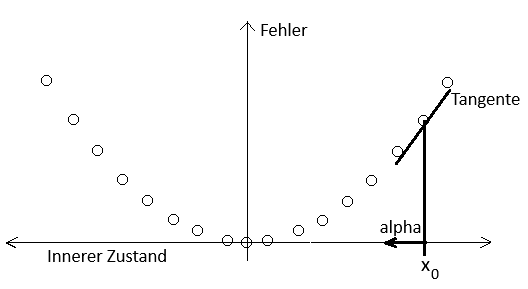

Das für das Finden des Fehlerminimums verwendete Verfahren ist in der Mathematik als Gradientenabstiegsverfahren bekannt. Es bewirkt, dass der innere Zustand des Netzes dahingehend verändert wird, dass er näher an den inneren Zustand rückt, der benötigt wird, um den Zielvektor zu erreichen. Mit dem neuen inneren Zustand wird der feststehende Eingabevektor erneut dem Netz übergeben und propagiert, wodurch ein neuer Ausgabevektor und mit ihm ein neuer Fehlervektor entstehen. Das wird solange fortgesetzt, bis man mit dem erreichten Wert zufrieden ist.

Die folgende Grafik veranschaulicht dieses Verfahren an einer quadratischen Fehlerfunktion. Es startet an einem zufällig gewählten inneren Zustand x0, geht mit Schritten der Länge alpha weiter in Richtung des Fallens der Tangente und endet in der Nähe des gesuchten Fehlerminimums.

Fehlerfunktionen sind keineswegs immer so einfach, wie in der Grafik dargestellt. Sie können mehrere globale und daneben auch noch lokale Minima haben, was die Suche nach dem richtigen aufwändig werden lässt. Die vorliegende Projektarbeit ist nicht der richtige Ort, um die zugehörigen mathematischen Operationen vorzustellen. Interessierte Studierende müssen auf den Bereich der Fehlerrechnung in der Mathematik verwiesen werden.