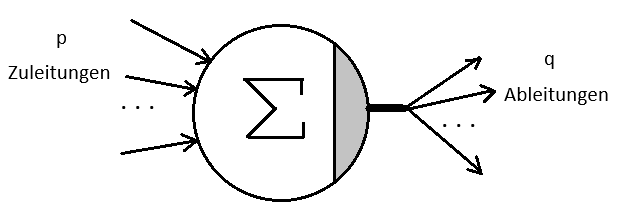

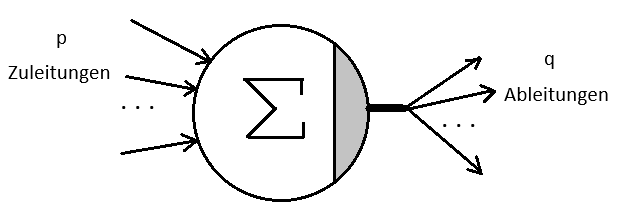

Neuronale Netze wurden bisher als strukturlose, analoge Schaltelemente beschrieben. Eine Verfeinerung zeigt, dass es sich um Vernetzungen weiterer, ebenfalls analoger, signalübertragender Schaltelemente handelt, die künstliche Neuronen (kurz: Neuronen) genannt werden und ihren biologischen Namensvettern nachempfunden sind. Sie haben jeweils p Zu- und q Ableitungen und sehen vereinfacht folgendermaßen aus:

Die Stärken der Signale auf den Zuleitungen werden im Neuron summiert und regen es an. Das Summenzeichen im Innern des Kreises der obigen Darstellung soll diesen Sachverhalt symbolisieren. Wird beim Anregungsvorgang ein bestimmter Schwellenwert überschritten, dann schaltet das Neuron und verändert dadurch den aufsummierten Wert. Man sagt dazu, es feuere. Der durch das Schalten entstandene Signalwert wird an alle q Ableitungen des Neurons übergeben. Die schraffierte Fläche mit ihrem verdickten Fortsatz soll den Schaltmechanismus (hier die Wirkung der Sigmoidfunktion) und die gemeinsame Weiterleitung andeuten.

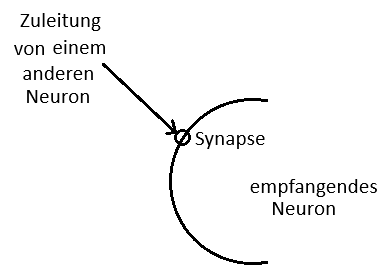

Ableitungen eines Neurons können zu Zuleitungen eines anderen werden. Die Verbindungsstellen zwischen den beiden Neuronen werden als Synapsen bezeichnet. Zuleitungen von einem Eingangspin sind dagegen ohne Synapse mit dem Neuron verbunden.

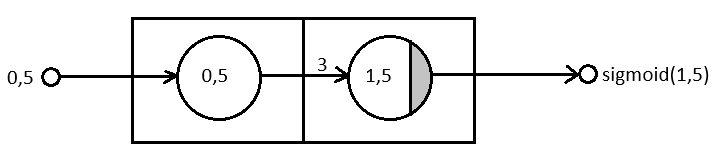

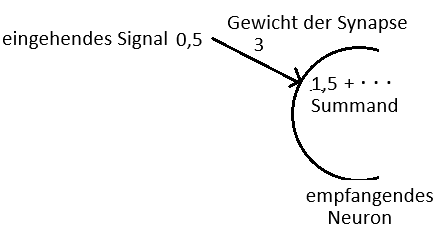

Ein biologisches Neuron hat zwischen 103 und 104 Synapsen. Sie transportieren Signale auf chemischem Weg und modifizieren deren Stärken. Sie können sie verstärken oder dämpfen. In graphischen Darstellungen werden Synapsen im Gegensatz zu dem obigen Bild nicht durch ein Symbol ausgedrückt. Vielmehr wird ihre multiplikative Wirkung auf das eingehende Signal an dem zu ihm gehörenden Pfeil notiert und als Gewicht (der Synapse) bezeichnet. Wenn in der folgenden Grafik über die gezeigte Ableitung ein Signal der Stärke 0,5 kommt und die Synapse ein Gewicht von 3 hat, dann geht ein Signal der Stärke 1,5 in den Summierungsvorgang des empfangenden Neurons ein:

Ein neuronales Netz besteht aus einer Sammlung von Neuronen, die durch ihre Ableitungen miteinander verbunden sind.

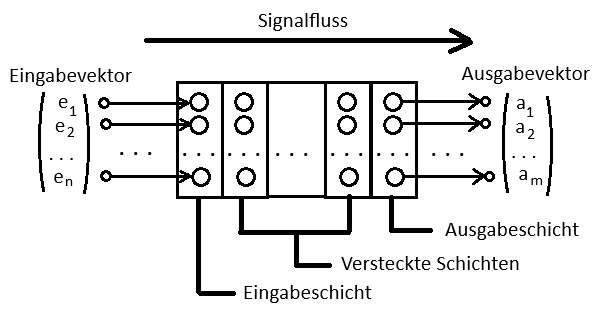

Je strukturell einfacher ein Netz gestaltet wird, desto leichter fällt seine (mathematische) Beschreibung. Eine erste Vereinfachung der potentiell hochkomplexen Netzstruktur besteht darin, die Neuronen in Schichten anzuordnen. Wird anschaulich von einem von links nach rechts gerichteten Signalfluss durch das Netzwerk ausgegangen, dann wird die linke Schicht Eingabeschicht genannt. Sie hat die Aufgabe, die Eingangssignale von den Eingangspins entgegenzunehmen und an die Neuronen der nächsten Schicht weiterzuleiten, ohne eine Schaltfunktion durchzuführen. An die Eingabeschicht können sich Schichten anschließen, die versteckte (hidden) Schichten genannt werden. Die Schichtenfolge endet rechts mit einer Ausgabeschicht. Ihre Ableitungen zeigen das Verarbeitungsergebnis des Netzes an und führen zu den Ausgangspins.

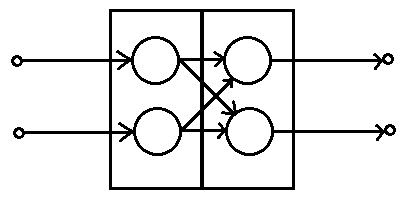

Eine weitere strukturelle Vereinfachung neuronaler Netze entsteht durch die Forderung, dass bei zwei direkt aufeinanderfolgenden Schichten von jedem Neuron der linken Schicht genau eine Ableitung zu jedem Neuron der rechten und nur zu diesen führt. Das heißt, dass es keine schichtübergreifenden und keine rückwärts gerichteten Ableitungen gibt, und keine, die zu einem Neuron derselben Schicht führen. Netze dieser Art werden als Feedforward-Netzwerke bezeichnet. Die folgende Grafik zeigt ein solches Netz, bestehend aus zwei Schichten mit je zwei Neuronen:

In der Eingabeschicht gibt es genau so viele Neuronen wie es Eingangspins gibt. Jedes Neuron einer Schicht hat genau so viele Ableitungen wie die nächste Schicht Neuronen hat. Zu fordern, dass alle Schichten gleich viele Neuronen enthalten sollen, ist für viele Anwendungen zu einschränkend. Deshalb wird oft lediglich verlangt, dass alle versteckten Schichten, wenn es denn welche gibt, gleich viele Neuronen enthalten sollen. Beim Einrichten des Netzes sind dann die Anzahlen an Neuronen für die Eingabeschicht, für die versteckten Schichten und für die Ausgabeschicht anzugeben. Wie bei der Eingabeschicht sind auch die Neuronen der Ausgabeschicht den Ausgangspins des Netzes in einer 1:1-Beziehung zugeordnet. Sie übergeben das von ihnen erzeugte Signal an die Ausgangspins.

Beginnend mit der zweiten Schicht erfolgen Zuleitungen an Neuronen über Synapsen, deren Wirkung durch ihr Gewicht ausgedrückt wird. Der innere Zustand eines neuronalen Netzes besteht aus der Gesamtheit dieser Gewichte.

Die Anfangsgewichte der Synapsen eines Netzes (und damit sein innerer Anfangszustand) sind zufällig gewählt und müssen so verändert werden, dass sie zusammen mit den Eingabesignalen zu den passenden Ausgabesignalen führen. Das ist ein Vorgang, der im vierten Kapitel als Trainieren des Netzes beschrieben wurde. Das Lernergebnis schlägt sich in den Gewichten der Synapsen und damit im aktuellen inneren Zustand des Netzes nieder.

Die Neuronen der Eingabeschicht führen keine Schaltvorgänge durch, die der Ausgangsschicht dagegen schon. Das heißt, dass es keine einschichtigen neuronalen Netze geben kann. Ein minimales neuronales Netz besteht aus einem Schichtpaar, das lediglich eine Ein- und eine Ausgabeschicht mit jeweils einem Neuron enthält: