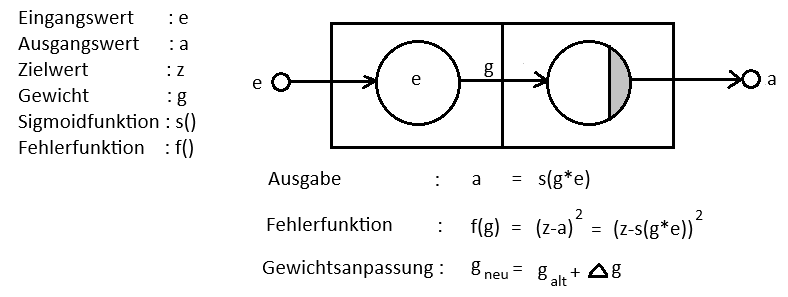

Das prinzipielle Vorgehen bei Gewichtsanpassungen soll zunächst am Beispiel des am Ende des 06-ten Kapitels vorgestellten minimalen Netzes aufgezeigt werden. Bei diesem Beispiel werden die Ausführungen nicht nur durch die geringe Anzahl an Schichten und Neuronen, sondern auch durch das Fehlen einer Fehlerrückpropagierung (Fehlerrückführung) vereinfacht, die hier gar nicht erst anfällt. Verwendet wird eine quadratische Fehlerfunktion. Das minimale Netz hat genau zwei Schichten mit genau einem Neuron in jeder. Hier sind alle beteiligten Vektoren und die (einzige) Gewichtsmatrix Skalare, also einzelne Zahlenwerte. Folgende Situation liegt vor:

Um das Gewicht g anzupassen, wird sein bisheriger Wert galt um einen (kleinen) Gewichtsanteil Δg verändert. Als Δg könnte die zugrundegelegte Schrittweite alpha für den Gradientenabstieg verwendet werden. Geschickter ist es, alpha durch die jeweilige Tangentensteigung so zu modifizieren, dass die Schritte um so kleiner werden, je näher sie der Steigung 0 kommen:

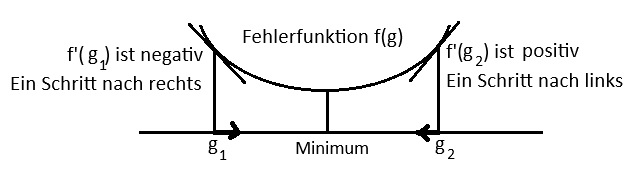

Noch offen ist die Frage, ob Δg zu galt addiert oder von galt subtrahiert werden muss. Dazu werden die Ableitungen der Fehlerfunktion betrachtet. Das ist eine quadratische Funktion, woraus folgt, dass, um zum Minimum zu gelangen, an einer Stelle, an der die Ableitung einen positiven Wert hat, ein Schritt nach links (galt - Δg) und bei einem negativen Wert ein Schritt nach rechts (galt + Δg) zu gehen ist:

Das bedeutet zusammenfassend, dass Folgendes gilt:

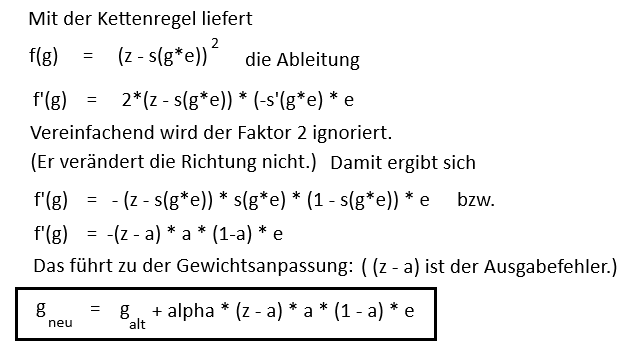

Jetzt ist noch f'(g) zu berechnen. Dazu wird die Ableitung der Sigmoidfunktion s(g*e) benötigt. Für sie ist bereits festgestellt worden, dass gilt:

Damit kann f'(g) berechnet werden:

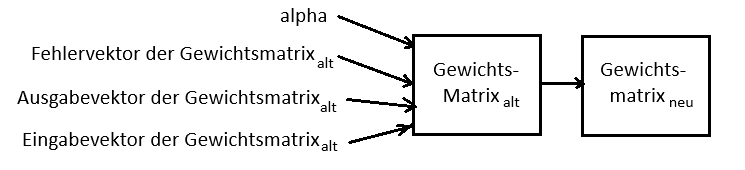

Die Betrachtungen zum minimalen Netz zeigen, welche Zahlenwerte benötigt werden, um die Elemente einer Gewichtsmatrix zu verändern:

Bei Netzen mit mehr als zwei Schichten ist die Schrittweite alpha für den Gradientenabstieg bei allen Gewichtsmatrizen identisch und durch das Einrichten des Netzes festgelegt. Von den anderen benötigen Werten sind bei allen Matrizen die jeweiligen Eingangs- und Ausgangsvektoren durch die bereits erfolgte Eingabepropagierung bekannt. Lediglich der Fehlervektor ist durch diese Propagierung nur für die letzte, anschaulich ist das die rechteste, Matrix ermittelt worden. Gibt es mehr als eine Gewichtsmatrix, dann muss der Fehler (von rechts nach links) Matrix für Matrix anteilig der jeweiligen Zuleitungsgewichte zurückpropagiert werden. Dieser Prozess endet, sobald die erste Matrix erreicht ist und geht - sinnvollerweise - nicht über sie hinaus.

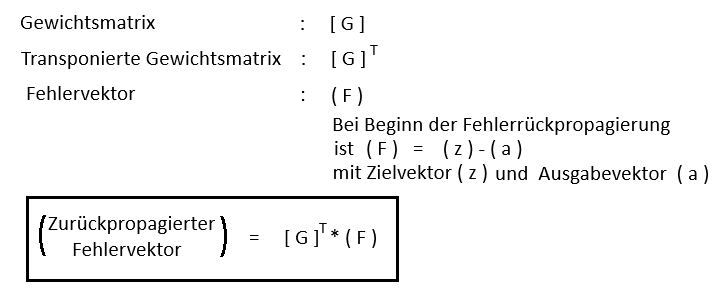

Damit die Fehlerrückpropagierung ebenfalls mithilfe der Matrizenrechnung formuliert werden kann, muss die Berechnung durch Weglassen einiger Terme etwas vereinfacht werden, wodurch jedoch die Tendenz der Berechnung nicht verändert wird. Als Matrizenrechnung arbeitet die Fehlerrückpropagierung vereinfacht folgendermaßen: Wird eine Gewichtsmatrix transponiert (Ihre Zeilen und Spalten werden vertauscht.), und wird diese transponierte Matrix mit dem zu ihr gehörenden Fehlervektor multipliziert, dann ergibt sich der zu ihrer Vorgängermatrix (Das ist die anschaulich links von ihr stehende.) gehörende Fehlervektor:

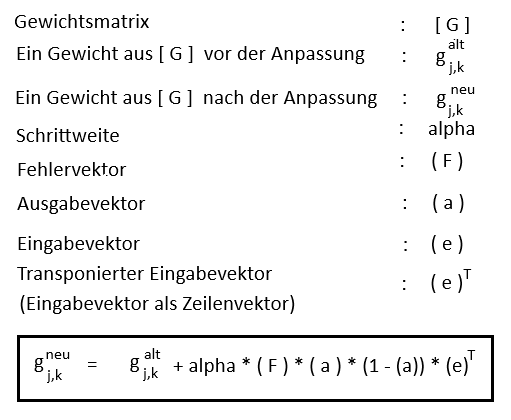

Der Startwert dieser Propagierung ist der Fehlervektor des gesamten Netzes. Die Fehlerrückpropagierung und die Gewichtsanpassungen werden der Reihe nach (anschaulich von rechts nach links) an allen Gewichtsmatrizen vorgenommen. Danach liegen für alle Gewichtsmatrizen alle für die Anpassung benötigten Werte vor. Die zugehörige Anpassungsformel für jede der Gewichtsmatrizen lautet: